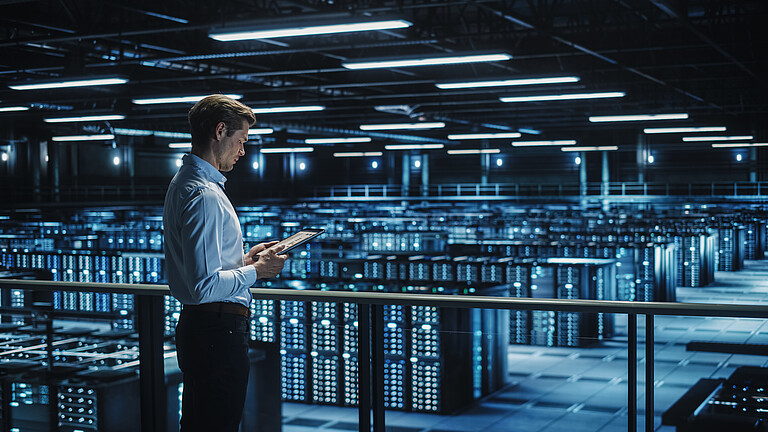

De juiste koelcapaciteit bepalen voor AI-workloads

Waarom IT-toepassingen verschillende koelprofielen hebben

AI verandert de manier waarop datacenters worden ontworpen. Waar 70 kW per rack bij traditionele IT-systemen al als high-density wordt gezien, komen AI-omgevingen inmiddels regelmatig uit op 136 kW per rack. Dat vraagt om een andere kijk op koeling.

Toch zit de uitdaging niet alleen in het hogere vermogen. Minstens zo belangrijk is de vraag hoe dat vermogen wordt gebruikt. Niet iedere AI-toepassing belast de infrastructuur op dezelfde manier. Multi-GPU-modules met gedeeld geheugen en geïntegreerde onboard-netwerken leveren enorme rekenkracht, maar de warmte die daarbij vrijkomt verschilt sterk per toepassing.

Die variatie is geen detail. Het is een bepalende factor bij het ontwerpen van de koeloplossing.

Niet elke AI-workload gedraagt zich hetzelfde

De drie meest voorkomende AI-scenario’s hebben elk hun eigen koelprofiel.

Chatbots en interactieve toepassingen draaien in inference-modus. Daarbij is de belasting hoog, maar relatief constant. De chips blijven tijdens het verwerken van aanvragen continu actief, maar omdat het belastingsniveau voorspelbaar is, kan de warmte stabiel worden afgevoerd. Voor het klimaatsysteem is dit een gunstig scenario: de koelvraag blijft constant en de installatie kan daarop worden afgestemd.

Industry 4.0-toepassingen laten een ander patroon zien. Denk aan productieplanning, kwaliteitscontrole met AI-gebaseerde beeldverwerking of industriële voorspellingssystemen. Hierbij wisselen intensieve rekenfasen zich af met pauzes. De belasting beweegt dus cyclisch tussen een middelhoog en hoog niveau. Dat vraagt om slimme regelingen die snel kunnen reageren en moeiteloos schakelen tussen verschillende vermogensniveaus.

AI-training is het meest veeleisende scenario. Training is sterk iteratief en afhankelijk van de data die op dat moment wordt verwerkt. De thermische belasting kan daardoor in zeer korte tijd sterk fluctueren. Afhankelijk van de grootte van de dataset, de modelcomponenten die worden getraind en het aantal GPU’s dat parallel draait, kunnen er forse pieken ontstaan. Een trainingsalgoritme kan bijvoorbeeld binnen enkele milliseconden opschalen van 60 procent belasting naar 100 procent en daarna terugvallen naar een basisbelasting van 15 tot 20 procent.

Waarom standaard koeling vaak niet genoeg is

Veel standaard vloeistofkoeloplossingen zijn niet ontworpen voor zulke dynamische belastingsprofielen. Daardoor lopen ze bij moderne AI-toepassingen al snel tegen hun fysieke grenzen aan.

Het probleem zit vooral in twee zaken: er is vaak te weinig thermische reserve en de systemen kunnen extreme belastingswisselingen niet altijd goed opvangen. Bij een constante belasting, zoals in inference-modus, blijft dat meestal beheersbaar. Maar tijdens AI-training ontstaan snelle pieken. Conventionele vloeistofkoelsystemen kunnen dan niet altijd snel genoeg het benodigde debiet leveren om de temperatuur effectief omlaag te brengen.

Om zulke pieken veilig op te vangen, is meer flexibiliteit nodig. Een toekomstbestendige liquid cooling-infrastructuur moet vrijwel naadloos kunnen schakelen tussen twee manieren van regelen:

- Inference-modus: dynamische koeling via temperatuur- of debietregeling, gericht op maximale efficiëntie.

- AI-training: statische regeling op basis van constante delta-p-waarden, oftewel drukverschil.

Drukverschilregeling is essentieel om een maximaal debiet te garanderen. Alleen zo kunnen ook extreme belastingpieken betrouwbaar worden opgevangen en wordt het systeem afgestemd op de daadwerkelijke piekvraag. Een modern vloeistofkoelsysteem moet dus zowel vraaggestuurd efficiënt kunnen werken als langdurig piekprestaties kunnen leveren.

Wat dit betekent voor de infrastructuur

De verschillen tussen AI-workloads hebben directe gevolgen voor de keuzes die bij het ontwerp van de infrastructuur worden gemaakt.

- Voor chatbotomgevingen ligt de nadruk vooral op betrouwbaarheid en energie-efficiëntie.

- Voor Industry 4.0-toepassingen zijn intelligente regelingen nodig die procescycli herkennen en adaptief kunnen reageren.

- Voor AI-training zijn thermische reserves cruciaal. Koelsystemen en klimaatcomponenten moeten zo worden ontworpen dat ze ook bij enorme belastingpieken niet aan hun limiet komen.

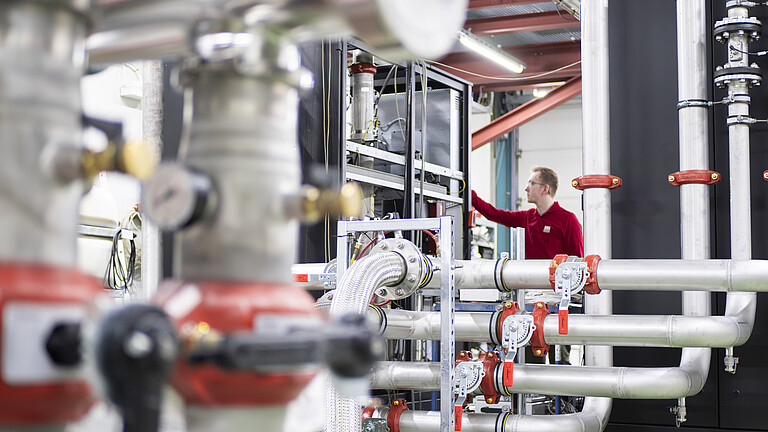

Testen onder realistische omstandigheden

De belangrijkste les: wie AI-infrastructuur wil realiseren, moet het verwachte workloadprofiel goed begrijpen. In de praktijk blijken werkelijke belastingspatronen namelijk vaak aanzienlijk af te wijken van theoretische berekeningen.

Daarom zijn pilotprojecten met opgeschaalde capaciteit zo belangrijk. Alleen door AI-toepassingen onder realistische omstandigheden te testen, kan de koeloplossing nauwkeurig worden afgestemd op de werkelijke koelvraag.

In het STULZ Test Center in Hamburg worden liquid-to-liquid-systemen gevalideerd op basis van praktische prestatie-indicatoren. Daarbij wordt niet alleen getest onder realistische scenario’s, maar ook gekeken naar stromingsstabiliteit over meerdere CDU’s en continue vloeistofmonitoring. Deze empirische aanpak helpt om kostbare planningsfouten te voorkomen en zorgt ervoor dat de infrastructuur geschikt blijft voor toekomstige hardwaregeneraties.

Conclusie: AI vraagt om koeling op maat

De tijd van one-size-fits-all-koelconcepten is voorbij. AI-datacenters vragen om een goed begrip van de workloads die op locatie draaien. Alleen dan kan de koeloplossing worden afgestemd op wat de infrastructuur echt nodig heeft.

Een succesvolle aanpak combineert drie elementen: een grondige analyse van de eigen workloadmix, samenwerking met technologieproviders zoals STULZ die onder realistische omstandigheden kunnen testen, en de bereidheid om via pilotprojecten gecontroleerd op te schalen.

Zo ontstaan datacenters die vandaag optimaal functioneren en ook morgen klaar zijn voor de volgende generatie AI-hardware.